Non hai voglia di leggere? Nessun problema, è ora disponibile la versione podcast dell’articolo (disclaimer: si tratta di un tool in versione beta):

- Introduzione

- Un risiko finanziario

- Le frecce dell’arco

- Grandi in tutti i sensi

- Nessuna magia

- Si può fare!

- Conclusioni

Introduzione

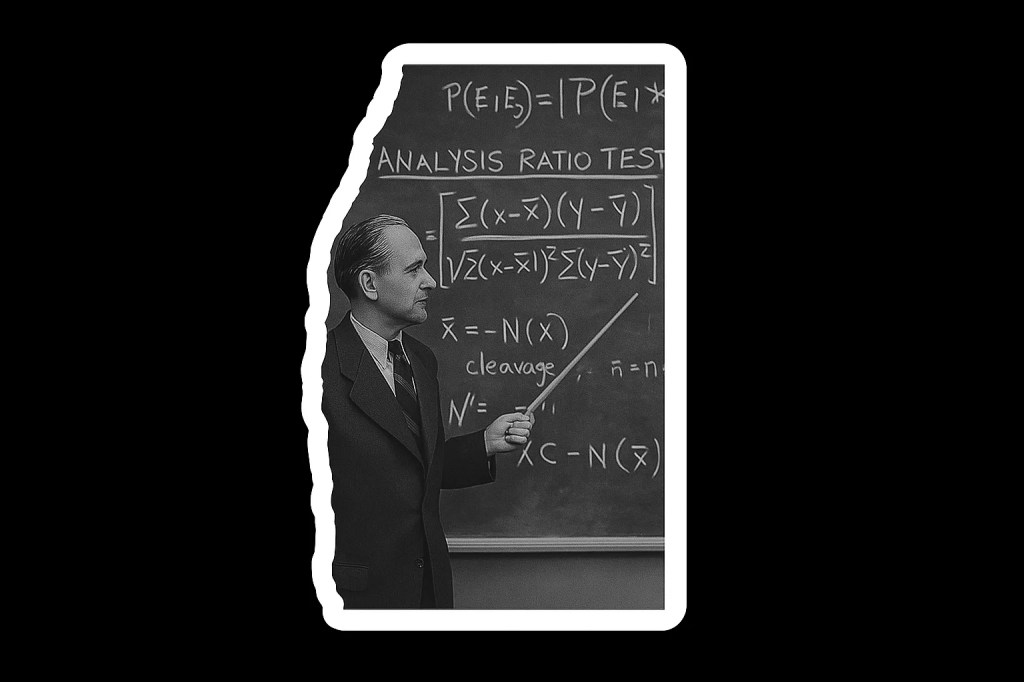

L’analisi quantitativa suscita sempre più interesse in ambito finanziario, poiché offre un sistema metodologico solido, fondato su principi statistici, matematici e informatici. Si tratta di un approccio che mira a conferire oggettività al processo decisionale, distinguendosi dalle strategie basate prevalentemente sull’intuizione o sulla lettura qualitativa dei mercati. Il ricorso a formule matematiche precise e a modelli statistici avanzati è senz’altro complesso, soprattutto per chiunque si avvicini per la prima volta a questo mondo; la logica di fondo però è semplice: comprendere i meccanismi di mercato attraverso indicatori misurabili, al fine di ridurre l’incertezza e migliorare l’accuratezza delle previsioni.

Il cuore di questa disciplina risiede in un insieme di tecniche che si sono affinate nel tempo. Se negli anni Cinquanta, con gli studi pionieristici di Harry Markowitz (cfr. “Portfolio Selection,” The Journal of Finance, 1952, vedi articolo 15), l’attenzione era concentrata sui criteri di diversificazione ottimale del portafoglio, oggi il panorama è molto più vasto. I professionisti dell’analisi quantitativa, noti spesso come “quants”, sviluppano modelli in grado di esplorare correlazioni tra variabili macroeconomiche e performance di asset finanziari o di “distillare” segnali utili dal rumore di fondo dei mercati. Le piattaforme software dedicate si moltiplicano e l’aumento esponenziale della potenza di calcolo apre a nuove possibilità.

I dati vengono trattati come una vera e propria risorsa, selezionati e puliti per eliminare le informazioni irrilevanti. D’altra parte, sono proprio la qualità e la corretta metodologia di trattamento ad influenzare maggiormente la solidità di qualunque modello quantitativo. Lontana dall’idea di sostituirsi al giudizio umano, l’analisi quantitativa fornisce strumenti per dare sostanza e spessore alle ipotesi su cui si basano le scelte d’investimento.

È innegabile che il successo dell’analisi quantitativa dipenda anche dalla capacità di interpretare i risultati. Confrontarsi con i numeri significa, infatti, porre le basi per una maggiore comprensione dei mercati, ma non si deve mai trascurare il contesto reale in cui si opera. In altre parole, i quants non si limitano a far girare codici o a leggere grafici, bensì cercano di individuare segnali robusti e di evitare illusioni cognitive. Questo richiede formazione continua e una sana dose di scetticismo, qualità che nel tempo contribuiscono alla maturazione di un approccio professionale, attento alla complessità e sempre allerta di fronte ai possibili bias.

Un risiko finanziario

Oggi l’analisi quantitativa non è più ristretta a pochi hedge fund d’élite o a reparti specializzati di banche d’affari. È entrata di diritto nella cassetta degli attrezzi di molti operatori, dalle grandi istituzioni alle start-up fintech. Chiunque desideri comprendere i mercati con maggiore profondità e coerenza, trova in questa disciplina un’alleata preziosa. Il suo impiego si rivela strategico per individuare inefficienze, valutare il rischio o definire l’asset allocation ideale. Oggi giorno l’approccio quantitativo in finanza non dovrebbe limitarsi, dunque, a una funzione di supporto, ma dovrebbe divenire parte integrante del processo di investimento.

Si osserva, inoltre, che gran parte della ricchezza gestita a livello globale adotta modelli quantitativi in un modo o nell’altro. Secondo un’analisi condotta dal Financial Times (https://www.ft.com/content/2e28fb42-de8a-40d7-8716-88cb5febe006?utm) sul mercato degli hedge fund, i fondi systematic quant hanno conosciuto una crescita significativa nell’ultimo decennio, grazie anche alla capacità di gestire enormi quantità di dati con tecniche di intelligenza artificiale e machine learning. Questo fenomeno implica che l’elemento umano, pur rimanendo centrale, spesso si affianca a una componente tecnologica che opera su regole ben definite, riducendo l’influenza delle emozioni e delle reazioni irrazionali tipiche dell’essere umano quando si trova a gestire situazioni di stress o forte incertezza.

Le grandi aziende multinazionali, le banche e persino i regolatori si appoggiano a metodi quantitativi per monitorare variabili fondamentali, valutare la stabilità del sistema finanziario o comprendere le possibili conseguenze delle proprie politiche. Gli studiosi della Federal Reserve americana, per esempio, utilizzano modelli di previsione macroeconomica che contemplano l’andamento di inflazione, disoccupazione e tassi di interesse, integrando i risultati con valutazioni qualitative. Questa commistione tra dati numerici e interpretazione consente di avere una lettura più precisa della realtà economica, rilevando segnali che altrimenti potrebbero passare inosservati.

Per il singolo investitore, l’analisi quantitativa offre inoltre la possibilità di costruire strategie di portafoglio che siano coerenti con la propria propensione al rischio e i propri obiettivi di rendimento. Si va dalla gestione dei drawdown alla diversificazione tra mercati e settori, passando per la ricerca di correlazioni non ovvie tra asset e fattori macroeconomici. In ultima analisi, il valore aggiunto è tangibile, poiché i modelli quantitativi forniscono un’ossatura rigorosa per valutare decisioni che altrimenti risulterebbero troppo condizionate da fattori emotivi o da previsioni basate sulla percezione.

Le frecce dell’arco

Esistono diversi metodi e strumenti di calcolo che si adattano a contesti e obiettivi differenti. Tra i metodi storici e consolidati, rientrano quelli di derivazione statistica, come la regressione lineare e il modello ARIMA, spesso impiegati per il forecast dei prezzi o di variabili macroeconomiche. Si affiancano, poi, metodi più complessi basati sull’analisi delle serie storiche con modelli di volatilità come GARCH, utili per misurare e prevedere l’incertezza dei mercati.

Un strumento particolarmente diffuso, è la simulazione di Monte Carlo, che genera scenari casuali in base ad assunzioni su variabili di mercato e consente di esplorare, attraverso un vasto numero di iterazioni, le diverse possibili evoluzioni di un portafoglio o di una strategia di investimento. Questo metodo risulta prezioso per valutare la robustezza dei modelli in condizioni di mercato imprevedibili, offrendo una prospettiva più ampia sul rischio rispetto ai calcoli basati su singoli scenari o dati storici limitati.

In altre parole, questa tecnica permette di ottenere risultati statisticamente più significativi rispetto alla realtà. Gli innumerevoli anni di storia dei mercati (in particolare di quelli Statunitensi), infatti, sono ben poca cosa se paragonati al volume di dati necessario ad un’analisi quantitativa ottimale. Ed è qui che la simulazione di Monte Carlo viene in soccorso dell’analista. Il set di informazioni concrete, come ad es. una certa serie storica di rendimenti, viene utilizzato come punto di partenza di una simulazione che reitera la sequenza migliaia di volte casualmente, creando scenari alternativi mai realizzatisi.

Tutto ciò, ovviamente, è divenuto possibile grazie all’evoluzione tecnologica e, in particolare, all’applicazione dell’informatica a tale ambito. Oggi giorno, si possono facilmente mettere a punto algoritmi che svolgono questo compito. Ad esempio, prendiamo un’ipotetica striscia di rendimenti quinquennale: 2%, 1,5%, 3%, 4%, -1%. Investendo 10.000 euro, alla fine ne otterresti 10.979,23. Ma cosa succederebbe se partendo da questi valori ne selezionassimo casualmente una parte componendo una diversa sequenza? Considerando 2%, 1,5%, -1%, 3%, -1% l’importo finale sarebbe 10.451,38. Ripetendo migliaia di volte questo processo, si possono ottenere risultati che permettono di prevedere con maggior certezza quello che potrebbe accadere in futuro.

Emerge poi la sempre maggiore rilevanza del machine learning, campo che spazia dal supervised al reinforcement learning e offre soluzioni efficaci per la classificazione, la stima di probabilità di default o l’identificazione di pattern non lineari. Le reti neurali artificiali e gli algoritmi di deep learning stanno acquisendo popolarità grazie alla loro capacità di gestire set di dati voluminosi e di elaborare segnali che sfuggono all’analisi tradizionale. Per mettere in pratica tutto questo, occorrono strumenti di calcolo adeguati. Le piattaforme più comuni vanno da software specializzati come MATLAB e R, fino a Python, che è attualmente una delle soluzioni più popolari grazie all’enorme ecosistema di librerie per l’analisi dei dati (NumPy, Pandas, SciPy, scikit-learn). In ambito professionale e accademico, esistono anche piattaforme di calcolo distribuito, essenziali quando si lavora con big data o si desidera eseguire in parallelo un gran numero di simulazioni. L’adozione di queste tecnologie è ormai pervasiva e aiuta a perfezionare il processo di ricerca: si possono testare velocemente differenti ipotesi, validare o smentire strategie e calibrarne i parametri con una precisione che il classico “foglio di calcolo” non potrebbe garantire.

Un ulteriore aspetto da non trascurare riguarda la crescente importanza degli strumenti di gestione del rischio, a partire dalle metriche di Value at Risk (VaR) e Expected Shortfall (ES). Tali indicatori consentono di quantificare la massima perdita potenziale di un portafoglio in un dato orizzonte temporale e con un determinato livello di confidenza. Benché criticati per la loro presunta rigidità e incapacità di cogliere eventi estremi – i c.d. cigni neri di cui abbiamo parlato nell’articolo 13 – questi strumenti restano ancora oggi tra i capisaldi dell’analisi finanziaria, integrando in modo significativo lo schema generale di valutazione.

Grandi in tutti i sensi

Come avrai intuito, qualunque modello quantitativo, per quanto sofisticato, dipende dalla qualità e dalla disponibilità dei dati. L’analisi statistica permette non solo di sopperire alla carenza degli stessi, ma anche di estrarre informazioni rilevanti quando il problema è, al contrario, l’enorme mole di record da verificare. Basti pensare ai flussi di ordini, alle chiusure giornaliere, alle fluttuazioni intraday e a tutti i dati macroeconomici e societari che popolano i database internazionali. Da qui si comprende subito che una corretta strategia di data management risulta essenziale: i quants non si limitano a raccogliere dati, ma li puliscono, li validano e li trasformano prima di integrarli nei propri modelli.

È emblematico il caso di molti hedge fund che hanno iniziato ad acquisire dati alternativi, come ad es. le immagini satellitari, per stimare l’andamento della produzione agricola o il traffico nei porti commerciali. Questa tendenza si inquadra nel fenomeno dei cosiddetti “big data”, dove la statistica assume un ruolo ancora più cruciale: non basta avere un’immensa base di informazioni, occorre saper individuare quali variabili siano realmente rilevanti e come correlarle agli indicatori di mercato. Diversi studi mostrano come l’analisi dei dati su larga scala stia rivoluzionando diversi settori, tra cui anche la finanza, suggerendo che la capacità di trarre insight da fonti non convenzionali costituirà un vantaggio competitivo decisivo nel prossimo futuro.

Oltre alla componente tecnologica, la statistica fornisce gli strumenti teorici per distinguere tra correlazioni apparenti e legami causali robusti. Calcolare l’errore standard, verificare l’intervallo di confidenza e condurre test di ipotesi sono attività che garantiscono la bontà dei risultati. Molte strategie di trading mostrano una performance straordinaria se testate su uno specifico intervallo temporale, ma si rivelano fragili quando vengono estese ad altri periodi o mercati. Questa dinamica è chiamata “overfitting” e rappresenta uno dei rischi principali in cui può incorrere chi svolge analisi quantitativa senza un adeguato rigore statistico. Il rimedio consiste nella costruzione di set di dati di training e di validazione separati, così da testare l’effettiva robustezza del modello su dati “nuovi” e non utilizzati per il fitting iniziale.

Padroneggiare la statistica vuol dire anche essere consapevoli dei suoi limiti e di quelli insiti nei dati. Esistono fenomeni che non sono facilmente catturabili con modelli lineari o con medie e varianze tradizionali, e ciò richiede competenze di frontiera, spesso sviluppate in contesti di ricerca avanzata. La finanza ha attinto a piene mani dalla fisica statistica, dalla teoria del caos, da discipline come la biomatematica e l’ingegneria informatica, un bagaglio culturale che si riflette nella sofisticazione di alcuni modelli di calcolo. Pertanto, la collaborazione tra economisti, matematici e ingegneri appare sempre più cruciale: solo fondendo queste prospettive si riesce a cogliere appieno il potenziale dell’analisi quantitativa e a sfruttarlo in modo efficace nel panorama finanziario attuale.

Nessuna magia

L’approccio quantitativo, per quanto possa apparire come un metodo infallibile basato su algoritmi e dati rigorosi, non è esente da criticità. Una delle maggiori sfide sta nella comprensione che qualunque modello si basa su semplificazioni della realtà. Anche gli algoritmi più complessi non riescono a catturare l’intera gamma di fattori psicologici, geopolitici e sociali che influenzano i mercati. Le crisi finanziarie – come quella del 2008, fortemente correlata alla complessità dei modelli di valutazione dei titoli garantiti da ipoteca – hanno dimostrato come un’eccessiva fiducia in determinati paradigmi quantitativi possa condurre a sottostimare i rischi sistemici.

Cionondimeno, i vantaggi rimangono evidenti. L’analisi quantitativa conferisce una base logica e replicabile alle decisioni di investimento, riducendo l’impatto della soggettività. In un mondo dominato dalle emozioni e dalle percezioni individuali, la capacità di fare affidamento su dati oggettivi offre un senso di stabilità. Inoltre, i modelli quantitativi consentono di effettuare stress test e simulazioni di scenario, procedure che aiutano a identificare punti di debolezza all’interno di un portafoglio o di una strategia d’investimento. Se condotti con i parametri corretti, tali test permettono di prendere decisioni più consapevoli in merito all’allocazione delle risorse, cercando di mitigare i rischi inutili.

La principale responsabilità di chi utilizza i modelli quantitativi sta nel non trasformarli in una sorta di dogma. Il rischio di “black box” è concreto: le formule, specialmente se complesse, possono indurre gli operatori meno esperti a credere che il modello abbia sempre ragione. In realtà, occorre saperlo interpretare e, se necessario, modificare i parametri, revisionando periodicamente le assunzioni di base. Il contesto di mercato può cambiare in modo improvviso, come si è osservato durante la pandemia di Covid-19, e i modelli costruiti su dati storici possono perdere la loro efficacia se le dinamiche sottostanti subiscono uno stravolgimento radicale. Secondo alcuni studi, innovazione tecnologica e mutamenti del quadro macroeconomico hanno un impatto non trascurabile sulla stabilità dei parametri quantitativi utilizzati nei modelli di previsione.

Si deve anche riconoscere la difficoltà di sommare in un unico profilo competenze di programmazione, matematica, statistica ed economia. Questo ha fatto sì che la figura del data scientist e del quantitative analyst sia estremamente ricercata e ben retribuita all’interno del mercato del lavoro finanziario. Tuttavia, per i team e le aziende che riescono a integrare queste competenze, l’approccio quantitativo diventa un vantaggio competitivo formidabile. In definitiva, i benefici prevalgono quando si uniscono rigore matematico e lucidità interpretativa, evitando così di cadere nell’illusione che basti “premere un pulsante” per ottenere certezze assolute.

Si può fare!

Ti chiederai a questo punto come l’analisi quantitativa possa tradursi in risultati tangibili. Uno dei casi più noti è quello di Renaissance Technologies, un hedge fund americano fondato dal matematico James Simons. La strategia di questo fondo si fonda quasi interamente su modelli quantitativi, e il suo principale veicolo, il Medallion Fund, ha registrato performance eccezionali per decenni, superando sistematicamente gli indici di riferimento. Gran parte del successo è dovuto alla qualità dei modelli statistici, arricchiti da dati alternativi e curati in modo ossessivo per eliminare ogni minimo errore.

Un altro esempio emblematico riguarda i fondi indicizzati a fattori (detti anche smart beta), che sfruttano l’analisi quantitativa per selezionare titoli sulla base di determinate caratteristiche, come il valore, la qualità, il momentum o la volatilità. Sulla scia delle ricerche di Eugene Fama e Kenneth French (cfr. “Common risk factors in the returns on stocks and bonds,” Journal of Financial Economics, 1993), molti gestori hanno implementato strategie factor-based con ottimi risultati, almeno in certi contesti di mercato. L’idea di fondo è semplice: i fattori spiegano gran parte dei rendimenti azionari di lungo periodo e identificare quelli con potenziale di sovraperformance può diventare una leva competitiva.

Anche grandi banche e società di investimento come Goldman Sachs, Morgan Stanley o BlackRock hanno dipartimenti dedicati allo sviluppo di modelli quantitativi avanzati. Questi istituti non solo gestiscono i portafogli, ma producono ricerche e previsioni di mercato che influenzano le scelte degli investitori in tutto il mondo. Spesso, i successi quantitativi derivano dalla combinazione di dati proprietari, capacità di elaborazione e una cultura aziendale aperta all’innovazione. È significativo notare come alcuni progetti di ricerca nascano proprio dalla collaborazione con università e centri di studi avanzati, creando un ponte diretto tra teoria e pratica.

Non mancano poi esempi di società fintech, che basano la propria offerta su algoritmi di robo-advisory. Attraverso piattaforme online, esse propongono portafogli automatizzati a costi contenuti, affidandosi a strategie quantitative per riequilibrare l’asset allocation e gestire il rischio in modo dinamico. Questa democratizzazione dell’analisi quantitativa rappresenta una delle tendenze più interessanti degli ultimi anni e il settore potrebbe crescere in modo esponenziale, rispondendo alle esigenze di una platea di investitori sempre più ampia.

Questi casi studio dimostrano come l’approccio quantitativo, se ben implementato, porti risultati concreti e offra un vantaggio significativo in termini di competitività. Naturalmente, non esistono formule magiche né garanzie di rendimento, ma l’utilizzo rigoroso di dati e modelli fornisce una base più solida su cui costruire le strategie di investimento. Per il lettore curioso, è un invito a esplorare questa disciplina con mente aperta, tenendo presente che ogni successo è frutto di ricerca, sperimentazione e continuo affinamento delle tecniche.

Conclusioni

Lo scenario attuale suggerisce che l’analisi quantitativa continuerà a evolversi e a guadagnare rilevanza. L’ascesa dell’intelligenza artificiale e dell’apprendimento automatico sta aprendo nuove strade, mentre i mercati finanziari diventano sempre più interconnessi, producendo una mole di dati in costante crescita. In questo contesto, risulta essenziale sapersi orientare tra metodologie diverse e tenere d’occhio le frontiere della ricerca, dove nuove teorie e modelli emergono con sorprendente rapidità. Per chi opera professionalmente, la padronanza di questi strumenti rappresenta spesso la differenza tra il rimanere al passo con i tempi e l’essere sopraffatti da dinamiche di mercato in continuo mutamento.

Si intravede una maggiore penetrazione dell’analisi quantitativa anche nelle aree della finanza decentralizzata e delle criptovalute, dove l’assenza di regolamentazioni tradizionali crea ambienti sperimentali ideali per l’innovazione. Inoltre, le preoccupazioni legate a fattori ambientali, sociali e di governance (ESG) stanno spingendo i quants a sviluppare metriche specifiche per valutare l’impatto sostenibile di un investimento.

La complessità di tali sfide rende ancora più urgente l’esigenza di competenze interdisciplinari. Il futuro dell’analisi quantitativa non si gioca solo nella capacità di elaborare numeri, ma nella comprensione del contesto economico e sociale, nella sensibilità verso i rischi sistemici e nel dialogo costruttivo con esperti di altri settori. Le università e i programmi di formazione specializzati stanno cercando di colmare il gap di competenze, e chi si affaccia oggi sul mercato trova un’ampia gamma di possibilità fino a ieri inesistenti.

In definitiva, l’analisi quantitativa non va considerata un semplice strumento tecnico, ma un approccio culturale al mondo degli investimenti e dell’economia. Offre vantaggi tangibili nell’identificare opportunità, nel mitigare i rischi e nel prendere decisioni più informate. Tuttavia, richiede un impegno continuo per comprendere e gestire la complessità dei mercati, senza cadere nella tentazione di delegare interamente ai numeri il compito di giudicare la realtà. Si tratta, in sostanza, di un percorso affascinante, che invita a un confronto costante con le proprie ipotesi e con l’enorme ricchezza di dati disponibili.

Stay tuned!

Grazie per aver letto questo articolo. Se hai domande o desideri condividere le tue esperienze, lascia un commento qui sotto. La tua opinione è importante!

Invia la tua richiesta

Se ti serve supporto per impostare strategie solide, scrivimi. Partiamo da obiettivi, vincoli e rischio; poi applichiamo metodo quantitativo e una cornice comportamentale per ridurre errori ricorrenti e rendere le decisioni più disciplinate.

Nota: le informazioni condivise sono di natura generale; eventuali valutazioni operative richiedono le verifiche e la documentazione previste.

Grazie per la risposta. ✨