Non hai voglia di leggere? Nessun problema, è ora disponibile la versione podcast dell’articolo (disclaimer: si tratta di un tool in versione beta):

- Conclusioni per il lettore frettoloso

- Perché tutti parlano di quantum computing

- Come funziona un qubit

- Hardware e architetture, dalla teoria al laboratorio

- Errore, decoerenza e correzione quantistica

- Software, algoritmi e fase NISQ

- Dove potrebbe creare valore in finanza

- Investire nel tema senza farsi catturare dalla narrativa

Conclusioni per il lettore frettoloso

Il quantum computing rappresenta una frontiera tecnologica che fonde informatica e meccanica quantistica, promettendo di rivoluzionare il nostro modo di calcolare. A differenza dei bit tradizionali, i qubit possono trovarsi in sovrapposizione di stati (essere 0 e 1 simultaneamente prima della misura) ed essere entangled tra loro, proprietà che consentono forme di calcolo parallelo non ottenibili con i computer classici[12][14]. Queste caratteristiche straordinarie sono il motivo per cui negli ultimi anni si è cominciato a parlare di quantum computing; un computer quantistico ben funzionante potrebbe risolvere problemi ritenuti intrattabili, con impatti potenziali dalla chimica alla finanza, dall’intelligenza artificiale alla crittografia[1][2]. La strada, però, è ancora lunga. Realizzare davvero questa visione comporta superare enormi sfide di ingegneria. I qubit vanno isolati in condizioni estreme (criogenia, ultra-vuoto) per mantenere la coerenza e anche così restano soggetti a errori e decoerenza in tempi brevissimi[25][31]. La correzione quantistica degli errori è teoricamente la soluzione, ma richiede un grande numero di qubit e operazioni aggiuntive; stiamo solo ora iniziando a vedere i primi segnali sperimentali che tale approccio è fattibile[32][35]. Ci troviamo quindi nell’era NISQ, in cui disponiamo di processori quantistici a decine di qubit, ancora rumorosi, con i quali sperimentare algoritmi in vista di futuri dispositivi più potenti[40][43]. Nonostante i limiti, questi dispositivi NISQ stanno consentendo progressi significativi. Ad esempio, si testano algoritmi ibridi quantistici-classici (come VQE e QAOA) per problemi di chimica o ottimizzazione e alcune demo hanno già mostrato come il quantum computing possa trovare soluzioni a problemi finanziari o industriali in modi diversi da quelli tradizionali[50][56].

Il concetto fondamentale da cogliere è che il quantum computing non è magia, è una tecnologia reale, basata su leggi fisiche solide, che però richiederà tempo e ingegno per maturare. Pensiamo a un computer quantistico come a una macchina che sfrutta regole controintuitive (l’atomo può stare in due stati contemporaneamente, due elettroni separati possono comportarsi come fossero un unico sistema, etc.) per eseguire calcoli molto particolari in modo estremamente efficiente. Alcuni di questi calcoli (come fattorizzare numeri enormi o simulare fedelmente molecole complesse) sono oggi fuori portata persino dei più potenti supercomputer ed ecco perché c’è tanto fermento. Se – o, forse, quando – riusciremo a costruire computer quantistici affidabili e su larga scala, apriremo porte oggi chiuse. Tuttavia, e questo è cruciale, attualmente i nostri prototipi sono ancora lontani da quel traguardo. I migliori possono eseguire solo programmi molto brevi prima che gli errori accumulati vanifichino il risultato. Siamo un po’ come agli albori dell’era informatica classica, con macchine gigantesche e delicate che possono fare solo calcoli semplici.

In termini pratici, cosa significa tutto ciò? Significa che nei prossimi anni il quantum computing coesisterà con il calcolo classico, integrandolo in nicchie specifiche. Aziende e governi stanno investendo per farsi trovare pronti. Nel settore finanziario si esplorano applicazioni per migliorare l’ottimizzazione di portafoglio, la gestione del rischio e la sicurezza delle transazioni[51][64]. Queste applicazioni potrebbero inizialmente manifestarsi come servizi cloud specializzati, offerti da provider quantistici per risolvere problemi particolari su richiesta. Anche la sicurezza informatica sta subendo un impulso grazie al quantum; da un lato, preparandosi alla minaccia futura (sviluppando e adottando algoritmi di crittografia resistenti ai quantistici), dall’altro sfruttando già tecniche quantistiche (come la distribuzione quantistica di chiavi) per elevare il livello di protezione dei dati sensibili[57][58].

Per chi è appassionato di tecnologia o investimenti, il consiglio è duplice. Primo: informarsi e formarsi. Il quantum computing non è più materia da soli fisici teorici – oggi esistono risorse divulgative, corsi online e toolkit software che permettono a ingegneri, matematici e developer curiosi di apprendere le basi. Comprendere concetti come sovrapposizione, entanglement, porta di Hadamard, fase nisq è alla portata di chiunque voglia dedicare un po’ di tempo e questo bagaglio culturale diventerà via via più prezioso man mano che la tecnologia avanzerà. Secondo: mantenere un sano equilibrio tra entusiasmo e realismo, che si tratti di aspettative tecnologiche o di scelte di investimento. Il potenziale c’è ed è enorme, ma nell’immediato occorre saper riconoscere i limiti attuali. Non farsi abbagliare da annunci sensazionali senza verificarne il contenuto (ad esempio, capire se una “supremazia quantistica” riguarda un problema accademico o uno pratico) e, d’altro canto, non farsi scoraggiare oltre misura dagli inevitabili intoppi lungo il cammino (ogni nuova tecnologia passa per fasi di hype e disillusione prima di maturare).

In conclusione, il quantum computing è un viaggio appena iniziato. Nel presente accende l’immaginazione e pone sfide scientifiche di prim’ordine; nel futuro, potenzialmente, potrebbe diventare un’infrastruttura invisibile ma fondamentale tanto quanto lo è oggi il calcolo. I concetti fondamentali da portare a casa sono: cos’è un qubit e come differisce da un bit, perché i computer quantistici potrebbero essere così potenti, quali ostacoli (errori, decoerenza) ne rallentano lo sviluppo e quali potrebbero essere le prime aree a beneficiarne. Armati di queste idee, si può seguire con maggior consapevolezza l’evoluzione del campo, preparandosi a un’era in cui “quantum” entrerà a far parte del vocabolario quotidiano della tecnologia. Insomma, all’orizzonte intravediamo computer che sfruttano i misteri dell’universo quantistico; ed è una prospettiva che vale la pena capire e seguire, perché potrebbe definire la prossima rivoluzione del mondo digitale[2][65].

Perché tutti parlano di quantum computing

Il quantum computing è spesso presentato come la prossima grande rivoluzione tecnologica, capace di risolvere problemi che i computer classici non possono affrontare[1][2]. Questa tecnologia sfrutta fenomeni quantistici per elaborare informazioni in modo esponenzialmente più efficiente su determinate classi di problemi. Ad esempio, un computer quantistico può valutare simultaneamente un numero enorme di possibili soluzioni, laddove un computer tradizionale dovrebbe esaminarle una per una. Ciò apre prospettive straordinarie in campi come la ricerca farmaceutica, la progettazione di nuovi materiali, la sicurezza informatica e la finanza (si pensi alla gestione del rischio e all’ottimizzazione di portafoglio)[1][3]. Non sorprende dunque che governi e aziende in tutto il mondo stiano investendo miliardi in questa tecnologia emergente; l’Unione Europea, ad esempio, ha finanziato un programma decennale da 1 miliardo di euro per il calcolo quantistico, con importanti centri di ricerca italiani coinvolti[4]. Negli Stati Uniti, in Cina e altrove si assiste a una corsa agli investimenti quantistici, motivata anche dal timore di restare indietro in quella che è percepita come una corsa strategica.

A dare ulteriore risonanza al quantum computing sono stati alcuni traguardi scientifici molto pubblicizzati. Nel 2019, ad esempio, un prototipo di processore quantistico di Google chiamato Sycamore ha eseguito in circa 200 secondi un calcolo che, secondo le stime, avrebbe richiesto migliaia di anni su un supercomputer tradizionale[5]. Questo annuncio di “supremazia quantistica” – ossia la dimostrazione di un calcolo svolto più velocemente da un computer quantistico che da qualunque calcolatore classico – ha catalizzato l’attenzione mediatica e fatto percepire il quantum computing non più come fantascienza ma come una realtà in rapido sviluppo. Si discute anche dell’impatto sulla crittografia; futuri dispositivi quantistici potrebbero decifrare gli attuali codici di sicurezza, spingendo governi e aziende a prepararsi con metodi di cifratura post-quantistica sin da ora[6][7]. In poche parole, si parla di quantum computing perché promette di rivoluzionare il modo in cui computiamo e proteggiamo le informazioni, con ricadute potenzialmente epocali in ogni settore ad alta intensità di calcolo.

Accanto all’entusiasmo esistono voci autorevoli che invitano alla cautela. Il fisico Sankar Das Sarma, pur riconoscendo che il calcolo quantistico è “uno degli sviluppi più importanti non solo della fisica ma di tutta la scienza”, ha sottolineato che concetti come entanglement e sovrapposizione “non sono bacchette magiche” pronte a trasformare la tecnologia nel prossimo futuro[8]. In altri termini, l’aura quasi mistica che circonda questi fenomeni quantistici a volte induce il pubblico a credere che i computer quantistici possano immediatamente risolvere qualsiasi problema, mentre in realtà ci vorranno anni di ricerca per renderli veramente utili su larga scala. Alcuni esperti parlano apertamente di hype e di una possibile bolla speculativa; dispositivi ancora limitati vengono presentati come miracoli imminenti, alimentando aspettative irrealistiche[9][10]. Eppure, anche queste critiche partono dal presupposto condiviso che la posta in gioco sia enorme. Il consiglio generale è, come sempre, quello di mantenere un sano equilibrio. Entusiasmarsi per i progressi del quantum computing – perché le potenzialità rivoluzionarie ci sono – ma al tempo stesso comprendere le sfide ancora aperte e i tempi necessari affinché questa tecnologia maturi pienamente[10].

Come funziona un qubit

Il cuore di un computer quantistico è il qubit (bit quantistico), l’analogo quantistico del bit dei computer classici[11]. Mentre un bit convenzionale può trovarsi solo in uno dei due stati mutuamente esclusivi – 0 oppure 1 – un qubit può trovarsi in una combinazione di stati, grazie al principio quantistico della superposizione. In termini semplici, un qubit può essere 0, 1, oppure 0 e 1 allo stesso tempo fino a che non viene misurato[12][13]. Possiamo immaginarlo come una moneta che ruota in aria: finché la moneta è in rotazione, non è né testa né croce ma una sovrapposizione di entrambi i risultati possibili. Solo quando cade (cioè quando effettuiamo una misura) “collassa” in uno dei due valori definiti. Allo stesso modo, un qubit prima della misura è descritto da una funzione d’onda che associa una certa ampiezza di probabilità allo stato 0 e un’altra allo stato 1[12]. La misura farà collassare questa sovrapposizione in uno dei due esiti, 0 o 1, in modo casuale ma con probabilità determinate da quelle ampiezze (che, al quadrato, indicano la probabilità di ciascun risultato). Questo comportamento probabilistico è controintuitivo rispetto all’elettronica classica, ma è perfettamente coerente con le leggi della meccanica quantistica.

Un altro concetto fondamentale è l’entanglement (intreccio quantistico). Se abbiamo due o più qubit, essi possono essere messi in uno stato entangled in cui le loro proprietà sono strettamente correlate. In un sistema entangled, misurare uno dei qubit determina istantaneamente lo stato degli altri, indipendentemente dalla distanza che li separa[14]. Einstein definì questo fenomeno “spooky action at a distance” (azione spettrale a distanza) proprio perché sembra violare l’intuizione classica di separatezza. È come se i qubit entangled diventassero un unico sistema, condividendo una sola funzione d’onda collettiva. Ad esempio, due qubit possono essere preparati in un’entanglement tale che, al momento della misura, uno risulti certamente 0 e l’altro certamente 1 – ma fino alla misura nessuno dei due ha un valore definito. Se si misura il primo e lo si trova in stato 0, sappiamo istantaneamente (e senza scambio di segnali) che il secondo sarà 1[15]. Questo non significa trasmettere informazioni più veloce della luce, bensì riflette una correlazione profonda stabilita al momento della preparazione dei due qubit. La sovrapposizione quantistica e l’entanglement sono risorse uniche dei qubit che permettono ai computer quantistici di elaborare l’informazione in modi impossibili per quelli classici[16][17]. Grazie all’entanglement, un’operazione su un qubit entangled influenza immediatamente anche gli altri qubit correlati, creando una potenza computazionale collettiva che cresce in modo esponenziale con il numero di qubit collegati.

In pratica, come si implementa fisicamente un qubit? A differenza dei bit classici, che possono essere rappresentati da dispositivi macro-scopici (come microswitch transistor che sono “aperti” o “chiusi”), un qubit deve essere un sistema quantistico a due livelli. Molti sistemi possono fungere da qubit; il polarizzatore di un fotone (luce polarizzata orizzontalmente vs verticalmente può rappresentare 0 e 1), lo spin di un elettrone (su o giù), il livello di energia di un atomo (stato fondamentale = 0, stato eccitato = 1) e così via[18][19]. In laboratorio oggi si usano vari tipi di qubit. I più diffusi nei grandi progetti industriali sono i qubit superconduttivi – minuscoli circuiti elettrici realizzati con materiali superconduttori e operanti a temperature prossime allo zero assoluto – impiegati da aziende come IBM e Google. Ci sono poi i qubit a ioni intrappolati – atomi carichi tenuti fermi in campi elettromagnetici e manipolati con laser – usati in particolare da istituzioni come IonQ e varie università. Qubit fotonici basati su particelle di luce, promossi ad esempio da aziende come PsiQuantum, che hanno il vantaggio di operare a temperatura ambiente e di poter viaggiare lungo fibre ottiche (ideali per comunicazione quantistica) ma presentano sfide nella costruzione di porte logiche deterministiche. Qubit in punti quantici semiconduttori (nanostrutture che confinano singoli elettroni) potenzialmente integrabili nelle fabbriche di chip; e persino qubit basati su atomi neutri eccitati in stati speciali detti di Rydberg[20][21]. Ognuna di queste piattaforme ha i suoi pro e contro in termini di tempi di coerenza, velocità delle operazioni, scalabilità e requisiti sperimentali. Ad oggi non esiste ancora un “vincitore” universale; la ricerca è attiva su tutti questi fronti, nonché su approcci più esotici (ad esempio i qubit topologici, teorizzati per essere intrinsecamente più robusti agli errori – un filone su cui lavora Microsoft – anche se finora non si dispone ancora di qubit topologici funzionanti)[22][23].

Hardware e architetture, dalla teoria al laboratorio

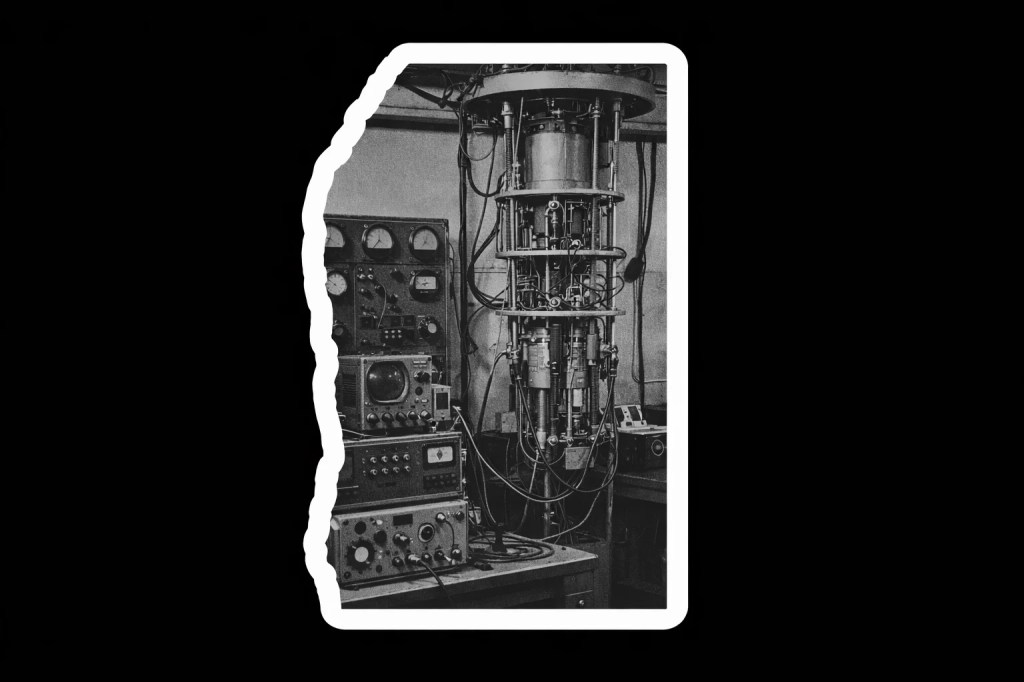

L’idea di computer quantistici fu concepita inizialmente negli anni ’80 a livello teorico (il famoso fisico Richard Feynman intuì per primo che un computer quantistico sarebbe ideale per simulare i sistemi quantistici stessi). Da allora, dalla teoria si è passati al laboratorio. Oggi disponiamo di dispositivi quantistici rudimentali che sfruttano varie implementazioni fisiche dei qubit. Come accennato, i qubit possono essere realizzati con materiali e tecnologie diverse, dando luogo a architetture hardware molto eterogenee[24][19]. Questa diversità ricorda gli albori dell’informatica classica, quando si sperimentava con valvole, relè, tubi a vuoto e transistor prima di convergere su standard condivisi. Nel caso quantistico, la sfida è persino più complessa, perché mantenere un sistema quantistico sotto controllo sufficiente per effettuare calcoli affidabili è estremamente difficile. I qubit sono sistemi delicati, che interagiscono facilmente con l’ambiente esterno perdendo le loro preziose proprietà quantistiche (il fenomeno noto come decoerenza, di cui parleremo a breve). Per questo, molte architetture richiedono condizioni estreme; i processori a qubit superconduttivi, ad esempio, devono essere raffreddati a pochi millesimi di grado sopra lo zero assoluto – temperature più fredde dello spazio interstellare – per entrare nello stato superconduttivo e ridurre al minimo i disturbi termici[25]. Questi chip quantistici sono inseriti in speciali cryostat a diluizione, enormi cilindri coibentati che ricordano un termos fantascientifico, con un labirinto di cavi e amplificatori che scendono nei vari stadi di raffreddamento fino al processore quantistico al fondo. Altre piattaforme, come gli ioni intrappolati, richiedono vuoto ultra-spinto (per isolare gli atomi) e batterie di laser di precisione per manipolare gli stati atomici. In pratica, un computer quantistico somiglia più a un piccolo laboratorio di fisica che a un elegante PC. Molti sistemi occupano grandi tavoli ottici con specchi e laser, oppure dilution refrigerator alti quanto un uomo, da cui pendono cablaggi dorati per connettere i qubit superconduttori posti nel ventre del refrigeratore.

Nonostante queste difficoltà ingegneristiche, il progresso negli ultimi anni è stato notevole. Siamo passati da dispositivi con 5-10 qubit negli anni 2000 a chip con oltre 50 qubit funzionali negli esperimenti accademici entro la fine degli anni 2010[26]. Oggi aziende come IBM hanno presentato processori con 127 qubit (processore Eagle, 2021) e 433 qubit (processore Osprey, 2022) e hanno in roadmap l’obiettivo di superare i 1000 qubit integrati su un singolo chip entro breve[27]. In effetti IBM nel 2023 ha annunciato il prototipo Condor da 1121 qubit, pietra miliare per raggiungere dimensioni tali da tentare la correzione degli errori su larga scala. Parallelamente, Google e altri concorrenti perseguono strategie simili, mentre startup come IonQ e Rigetti lavorano su architetture alternative (ioni e superconduttori rispettivamente) nel tentativo di aumentare il numero di qubit e la qualità delle operazioni. Esistono anche approcci quantistici non universali già disponibili, come i computer quantistici di annealing quantistico (es. D-Wave), specializzati in risolvere problemi di ottimizzazione tramite processi quantistici analogici. Sebbene questi dispositivi di annealing non eseguano circuiti quantistici generici e non offrono entanglement esteso come i sistemi a gate, rappresentano una delle prime applicazioni commerciali del quantum computing su problemi specifici di tipo combinatorio.

Va però sottolineato che la potenza di un computer quantistico non dipende solo dal numero di qubit. Conta molto la qualità di quei qubit; quanto a lungo rimangono coerenti, con che fedeltà possiamo controllarli e leggerli e come sono connessi tra loro. Per confrontare diverse macchine, IBM ha proposto la metrica del Quantum Volume (QV), che tiene conto non solo della quantità di qubit ma anche del tasso di errore e del livello di connessione e parallelismo fra essi[28][29]. Un QV più alto indica un computer quantistico capace di eseguire con successo circuiti quantistici più complessi. Ad esempio, un dispositivo con 100 qubit molto rumorosi e isolati potrebbe avere un QV minore di uno con 50 qubit più stabili e ben interconnessi. Questo per dire che l’architettura hardware non si limita al numero di qubit, ma include l’insieme di soluzioni circuitali e tecniche di controllo per massimizzare le prestazioni quantistiche. Attualmente si studiano architetture modulari e scalabili, ad esempio collegando tra loro più chip quantistici (tramite connessioni ottiche tra qubit, creando una sorta di rete quantistica di processori)[30]. Siamo agli inizi di una lunga strada. Come accadde per i computer classici, potremmo trovarci di fronte a decenni di miglioramenti incrementali e scoperte occasionali di nuove soluzioni (si pensi all’invenzione del transistor o del circuito integrato nel mondo classico) prima di sfruttare appieno il potenziale del quantum computing. Nel frattempo, i prototipi odierni – per quanto ingombranti e complicati da gestire – ci permettono già di sperimentare algoritmi quantistici su piccola scala e di preparare le basi per le tecnologie di domani.

Errore, decoerenza e correzione quantistica

Uno dei maggiori ostacoli sulla strada verso computer quantistici utili è la gestione degli errori. I qubit, per loro natura, sono sistemi fragili. Interagendo con l’ambiente perdono le proprietà quantistiche (entrano in decoerenza) e le operazioni quantistiche non sono perfettamente affidabili. Mentre un bit classico in un circuito può essere protetto da errori con tecniche semplici (ad esempio replicando segnali o usando codici di correzione dell’errore già dagli anni ’50), per un qubit la situazione è molto più complessa. Un qubit deve restare in una sovrapposizione coerente di stati durante il calcolo, ma quasi tutto può farlo decoerere: un blip di calore, una vibrazione, un campo elettromagnetico spurio, perfino l’imperfetta calibrazione dei controlli di laboratorio. Nei processori attuali, qualsiasi informazione quantistica immagazzinata tende a degradarsi nel giro di microsecondi o millisecondi, se non addirittura in tempi più brevi, a seconda della tecnologia[31]. Questo significa che, senza contromisure, un algoritmo quantistico con troppe operazioni vedrà il proprio stato quantistico “sporcare” progressivamente fino a produrre solo rumore casuale come output. Inoltre, ogni operazione quantistica (gate) ha una certa probabilità di errore intrinseca – ad esempio un’azione con un laser su un atomo potrebbe fallire l’aggancio allo stato desiderato 1 volta su 100 o 1 su 1000 a seconda della precisione. Questi errori si accumulano durante l’esecuzione dell’algoritmo.

Per costruire computer quantistici scalabili, è indispensabile implementare la correzione degli errori quantistici (QEC, Quantum Error Correction). L’idea, proposta a metà degli anni ’90, è affascinante. Si possono codificare le informazioni di un qubit logico (ideale e privo di errori) distribuendole su molti qubit fisici reali, in modo che se alcuni qubit fisici subiscono errori, l’informazione logica globale posso essere recuperata grazie all’entanglement e alla ridondanza. In pratica, si crea un codice quantistico che intreccia gli stati di, ad esempio, una dozzina di qubit fisici per formare 1 qubit logico protetto. Misurando opportunamente alcuni qubit “di controllo” (ancora entangled con quelli di dati) è possibile rilevare la presenza di errori sui qubit senza distruggere l’informazione logica e quindi correggerli applicando gate di correzione. Il concetto è analogo ai codici di correzione classici (come il codice Hamming) ma reso complicato dal fatto che non si può copiare un qubit (il teorema di no-cloning in meccanica quantistica) e che misurare direttamente i qubit distruggerebbe la sovrapposizione. Si usano quindi misure indirette (syndrome measurements) per individuare gli errori senza leggere il dato quantistico vero e proprio.

In sintesi, gli errori quantistici sono attualmente il più grande freno alle prestazioni dei computer quantistici. La decoerenza riduce il tempo utile per il calcolo (coherence time) a brevissimi intervalli, obbligando a completare gli algoritmi prima che lo stato quantistico si degradi. La correzione quantistica offre una via teorica per superare questi limiti, al prezzo di un enorme overhead di qubit e operazioni. I progressi nell’aumento della coerenza dei qubit individuali (mediante migliori materiali, isolamento e controllo) e nell’abbassare i tassi di errore di gate sono costanti ma graduali[10]. Si lavora su miglioramenti incrementali (ad esempio filtrare meglio il rumore elettrico, usare pulsi di controllo ottimizzati, design di hardware più stabile) e su leap concettuali (come l’approccio topologico che codificherebbe l’informazione in stati globali insensibili ai disturbi locali). Fino a quando non disporremo di qubit robusti o di efficaci schemi di correzione pienamente implementati, i nostri computer quantistici rimarranno nel regime “rumoroso” e sarà difficile aumentare il numero di operazioni senza perdere il segnale quantistico. Ma ogni anno si stabiliscono nuovi record di fedeltà e durata. Il recente superamento della soglia di correzione suggerisce che non c’è un limite fondamentale insormontabile; con ingegneria e ingegno, la scalabilità quantistica potrebbe essere solo questione di tempo (e risorse). Gli esperti stimano tuttora che potrebbero volerci 10-15 anni prima di vedere computer quantistici pienamente corretti e utili a problemi commerciali su larga scala[38][39], ma il percorso è tracciato e gli ostacoli, per quanto ardui, stanno cominciando a essere affrontati uno dopo l’altro.

Software, algoritmi e fase NISQ

Parallelamente alle sfide hardware, vi è un fiorente ambito di ricerca sul software quantistico, lo sviluppo di algoritmi e programmi che sfruttino al meglio i dispositivi quantistici. Un algoritmo quantistico è una sequenza di operazioni (gate quantistici) applicate a un insieme di qubit, in modo analogo a come un algoritmo classico è una sequenza di operazioni logiche su bit. La differenza è che le operazioni quantistiche possono creare e manipolare sovrapposizioni ed entanglement, permettendo in alcuni casi soluzioni più rapide. Già negli anni ’90 furono scoperti algoritmi quantistici rivoluzionari. L’algoritmo di Shor (1994) dimostrò teoricamente che un computer quantistico potrebbe fattorizzare numeri interi enormi in tempi fattibili, una capacità con implicazioni immense perché romperebbe la crittografia RSA su cui si basa la sicurezza di Internet[40][41]. Subito dopo arrivò l’algoritmo di Grover (1996), che permette di cercare un elemento in un database non ordinato in un tempo proporzionale alla radice quadrata del numero di elementi, offrendo un’accelerazione quadratica rispetto a qualsiasi algoritmo classico possibile. Questi risultati scossero la comunità scientifica, perché per la prima volta si vedeva che il quantum computing poteva essere più potente del calcolo classico su problemi concreti (fattorizzazione, ricerca). Negli anni seguenti è nata un’intero “Zoo” di algoritmi quantistici noti[42]. Oggi contiamo protocolli per la simulazione di sistemi chimici e fisici, per risolvere sistemi lineari di equazioni, per l’ottimizzazione combinatoria e persino per il machine learning quantistico. Molti di questi algoritmi sono descritti in letteratura specialistica[41], ma è importante capire che spesso la loro realizzazione pratica richiede computer quantistici ideali, ovvero con migliaia di qubit e correzione degli errori – capacità che non avremo ancora per qualche tempo.

Ed è qui che entra in gioco l’acronimo NISQ, coniato dal fisico John Preskill. NISQ sta per “Noisy Intermediate-Scale Quantum”, cioè “quantistico rumoroso a scala intermedia”[43]. Descrive lo stadio attuale (e prossimo futuro) della tecnologia quantistica. Abbiamo dispositivi quantistici con un numero intermedio di qubit (diciamo decine o poche centinaia, non milioni) che sono ancora rumorosi, ovvero affetti da errori e decoerenza, senza correzione d’errore completa. Preskill nel 2018 sottolineò che i computer NISQ, con ~50-100 qubit, avrebbero potuto fare cose oltre la portata dei supercomputer tradizionali, pur non essendo ancora abbastanza potenti da cambiare il mondo da un giorno all’altro[40]. E aveva ragione; infatti, nel 2019 abbiamo visto esempi (come l’esperimento di Google citato prima) di quantum advantage su compiti specifici. Tuttavia, questi primi vantaggi quantistici non hanno ancora utilità pratica (Google fece calcoli su distribuzioni casuali appositamente scelti per essere difficili ai classici ma non risolveva un problema di interesse applicativo diretto). La vera domanda è: cosa possiamo farci di utile con i computer NISQ? La risposta non è ancora del tutto chiara, ma sono emerse alcune strade promettenti. Una è la simulazione quantistica di sistemi fisici, usando i qubit per emulare direttamente altri sistemi quantistici (molecole, materiali, ecc.), sperando di poter studiare ad esempio la chimica quantistica meglio di quanto possano fare i computer classici. Un’altra strada sono gli algoritmi ibridi quantistici-classici, come VQE (Variational Quantum Eigensolver) e QAOA (Quantum Approximate Optimization Algorithm)[44]. Questi algoritmi delegano una parte del lavoro a un piccolo circuito quantistico e un’altra parte a un algoritmo classico tradizionale, lavorando in tandem. Ad esempio, VQE cerca di trovare l’energia minima di una molecola modellando lo stato quantistico della molecola su alcuni qubit e usando un algoritmo di ottimizzazione classico per regolare gates quantistici in modo variazionale finché l’energia (misurata dal circuito quantistico) scende. Questo schema sfrutta la capacità del quantum di rappresentare stati quantistici complessi (impossibili da memorizzare esattamente in un classico quando la molecola cresce), usando però il classico per guidare la ricerca di quella rappresentazione. QAOA, invece, affronta problemi di ottimizzazione combinatoria (come selezionare il miglior insieme di scelte dato un certo criterio) usando un circuito quantistico di profondità ridotta il cui output viene ottimizzato iterativamente da un computer classico per avvicinarsi alla soluzione ottima. Questi algoritmi ibridi sono adatti ai NISQ perché tollerano circuiti corti e qualche rumore e possono fornire soluzioni approssimate potenzialmente migliori o più veloci di quelle classiche, qualora il quantum riesca a esplorare lo spazio delle soluzioni in modo vantaggioso grazie alla sovrapposizione.

Un altro filone di ricerca software è il quantum machine learning. Si studiano versioni quantistiche di modelli di apprendimento (reti neurali quantistiche, support vector machine quantistici, algoritmi di clustering quantistici, ecc.)[45][46]. L’idea è che un computer quantistico potrebbe analizzare pattern in grandi moli di dati più velocemente, oppure rappresentare correlazioni ad alta dimensione in uno spazio di Hilbert enorme in maniera naturale. Alcuni risultati teorici mostrano accelerazioni interessanti, ma spesso queste richiedono molte risorse quantistiche (quindi rimangono speculative finché non avremo hardware migliore). Nel breve termine, però, alcune aziende e gruppi di ricerca stanno già sperimentando algoritmi quantistici di machine learning su dati ristretti, per vedere se emergono vantaggi (ad esempio, per il riconoscimento di pattern difficili o la generazione di dati sintetici). Finora non c’è stata ancora l’applicazione killer dimostrata su hardware NISQ che superi i classici, ma la fase NISQ è vista proprio come un banco di prova; un periodo in cui provare di tutto, imparare a programmare questi nuovi dispositivi e capire dove possano dare valore aggiunto[47][48]. In quest’ottica sono nati anche vari framework software che permettono a programmatori e ricercatori di scrivere codice quantistico senza doversi occupare dei dettagli hardware di basso livello. Librerie come Qiskit (di IBM), Cirq e TensorFlow Quantum (di Google), Pennylane (per programmazione quantistica variazionale) e altre ancora consentono di definire circuiti quantistici con un linguaggio di alto livello e di eseguirli su simulatori o sui veri chip quantistici messi a disposizione via cloud. Ad esempio, IBM Quantum offre accesso libero via internet a piccoli processori quantistici (5-7 qubit) per scopi educativi e a macchine più grandi per collaborazioni di ricerca, il che ha creato una vivace comunità di quantum developers già oggi.

Dove potrebbe creare valore in finanza

Tra i settori potenzialmente più rivoluzionati dal quantum computing, la finanza occupa un posto di rilievo. Molte attività finanziarie si basano su elaborazioni complesse di grandi quantità di dati e variabili – terreno fertile, in teoria, per i futuri computer quantistici. Vediamo alcuni ambiti specifici in cui il quantum computing potrebbe creare valore nel mondo finanziario[49].

Ottimizzazione di portafoglio e allocazione di asset. Banche e fondi di investimento affrontano quotidianamente problemi di ottimizzazione: allocare capitali tra decine o centinaia di asset in modo da massimizzare il rendimento atteso e minimizzare il rischio, rispettando vincoli regolamentari e di liquidità. Questo è un classico problema NP-difficile che cresce combinatoriamente con il numero di asset. I computer quantistici, con la loro capacità di esplorare simultaneamente molte combinazioni, promettono di risolvere certi problemi di ottimizzazione molto più rapidamente[50]. In particolare, algoritmi quantistici come l’accennato QAOA o l’annealing quantistico possono cercare soluzioni vicine all’ottimo globale evitando di restare intrappolati in ottimi locali, cosa che capita spesso ai metodi classici. Ad esempio, il gruppo di ricerca di Citi Bank ha sperimentato algoritmi QAOA su problemi di ottimizzazione di portafoglio, in collaborazione con una startup quantistica, per valutare se l’approccio quantistico potesse superare i metodi tradizionali nel trovare l’allocazione ideale di un insieme di investimenti[51]. I risultati iniziali, sebbene su scala ridotta, suggeriscono che i computer quantistici potrebbero in futuro analizzare scenari di mercato e reagire più velocemente ai cambiamenti, permettendo strategie d’investimento più reattive e sophisticated.

Gestione del rischio e simulazioni Monte Carlo. Molte istituzioni finanziarie utilizzano simulazioni di Monte Carlo per valutare rischi di portafoglio, calcolare prezzi di derivati complessi o fare stress test sui bilanci delle banche. Queste simulazioni richiedono di far evolvere stocasticamente sistemi con molte variabili (tassi d’interesse, tassi di default, oscillazioni di mercato) generando migliaia o milioni di scenari possibili. Un computer quantistico può accelerare certe simulazioni sfruttando l’ampiezza di probabilità per codificare distribuzioni ed evolverle in parallelo. Un esempio pratico è lo studio condotto dalla Bank of Canada, che ha esplorato l’uso di algoritmi quantistici di Monte Carlo per simulare scenari di stress finanziario (ad esempio improvvise svalutazioni di asset e vendite a catena) più rapidamente e con maggiore accuratezza[52][53]. Utilizzando tecniche come l’amplitude estimation quantistica, è teoricamente possibile ottenere una quadratica accelerazione nelle simulazioni Monte Carlo – il che significherebbe, ad esempio, dimezzare l’errore statistico con lo stesso numero di simulazioni o ottenere lo stesso livello di precisione con un quarto delle simulazioni rispetto al classico. In finanza ciò si traduce in misure di rischio (come il Value at Risk o il CVaR) calcolate più velocemente e con maggiore granularità, consentendo decisioni più informate sulla copertura dei rischi e i requisiti di capitale. Anche il calcolo di prezzi di derivati complessi (opzioni esotiche, derivati creditizi di portafoglio, ecc.) tramite metodi quantistici potrebbe accelerare la valutazione e favorire una migliore gestione del mercato e del rischio.

Ottimizzazione della liquidità e gestione collaterale. Un altro campo dove il quantum potrebbe apportare valore è nell’allocazione ottimale delle risorse finanziarie vincolate. Ad esempio, le grandi banche devono gestire collaterale (garanzie) tra diverse controparti e clearing house per minimizzare i costi mantenendo i requisiti di sicurezza. Questo significa risolvere quotidianamente problemi di ottimizzazione vincolata con migliaia di variabili (quanti titoli allocare a garanzia di quale esposizione, in modo da usare il meno capitale possibile ma rispettando tutte le soglie di rischio). Algoritmi quantistici di ottimizzazione combinatoria possono affrontare problemi simili. Recentemente, Multiverse Computing ha condotto esperimenti con banche europee (Crédit Agricole, BBVA) utilizzando algoritmi quantistici – in particolare combinando reticoli tensoriali per ridurre la dimensionalità e annealing quantistico – per ottimizzare l’allocazione del collaterale, ottenendo riduzioni nei costi e miglioramenti nella liquidità disponibile rispetto ai metodi classici usati attualmente[54]. Anche se questi test sono preliminari, essi mostrano come il quantum computing possa trovare soluzioni più efficienti in problemi finanziari concreti, con impatto diretto sul risparmio di capitale e sull’efficienza operativa delle istituzioni.

Rilevamento delle frodi e analisi dei dati finanziari. Il settore finanziario genera moli enormi di dati – dalle transazioni con carte di credito alle operazioni di trading in borsa – e individuare comportamenti anomali o pattern utili è cruciale. Si pensi al fraud detection (rilevamento di transazioni fraudolente) o all’analisi del comportamento dei clienti (ad esempio per prevenire il churn, l’abbandono dei clienti). Qui entra in gioco il quantum machine learning. Un algoritmo quantistico di machine learning può, in teoria, scandagliare spazi di feature ad alta dimensione molto più velocemente e identificare correlazioni sottili nei dati. La banca internazionale HSBC e altre stanno esplorando algoritmi quantistici per generare chiavi crittografiche sicure o per migliorare la sicurezza delle transazioni su blockchain usando la casualità quantistica[55], ma un aspetto altrettanto interessante è l’uso di modelli QML per la rilevazione di frodi su transazioni. Ad esempio, Intesa Sanpaolo ha avviato con IBM uno studio sull’utilizzo di algoritmi quantistici di intelligenza artificiale per identificare transazioni anomale nelle transazioni dei clienti[56]. In un test iniziale, un modello quantistico di classificazione ha mostrato potenzialità nel ridurre i falsi positivi/negativi rispetto ai sistemi tradizionali, segno che potrebbe cogliere schemi fraudolenti sfuggiti ai metodi attuali. Allo stesso modo, la previsione del churn (individuare in anticipo quali clienti stanno per lasciare un servizio bancario) potrebbe migliorare con algoritmi quantistici capaci di analizzare dataset complessi di comportamenti dei clienti e trovare indicatori predittivi nascosti[56]. Ancora siamo in una fase in cui questi algoritmi quantistici sono testati su sottinsiemi di dati per verificarne la bontà, ma l’interesse del settore è alto. Molte banche partecipano a consorzi e hackathon quantistici proprio per non farsi trovare impreparate qualora il “quantum advantage” nel data analytics finanziario dovesse materializzarsi.

Sicurezza e criptovalute. Un altro ambito cruciale è la sicurezza informatica finanziaria. Da un lato, come già menzionato, i computer quantistici futuri potrebbero rompere gli schemi crittografici attuali (RSA, ECC) su cui si basano le transazioni sicure e l’intera infrastruttura bancaria. Dall’altro, la stessa tecnologia quantistica offre strumenti per proteggere le comunicazioni: ad esempio, la Quantum Key Distribution (QKD) consente a due parti di scambiarsi chiavi crittografiche inviolabili, garantite dalle leggi della fisica quantistica. Diverse banche stanno sperimentando reti QKD per proteggere dati sensibili. Nel 2022, Danske Bank in Danimarca ha condotto la prima trasmissione di dati protetta da chiavi quantistiche al di fuori di un laboratorio, collegando due data center simulati con un canale QKD e dimostrando la fattibilità di integrare questa tecnologia nelle reti bancarie[57][58]. Progetti simili sono in corso in Europa (ad esempio la rete OPENQKD) per preparare il settore finanziario all’era “quantum-safe”. Allo stesso tempo, istituzioni come HSBC hanno testato l’uso di generatori quantistici di numeri casuali e chiavi quantistiche all’interno di piattaforme blockchain per la custodia sicura di beni digitali come l’oro tokenizzato[55]. Inoltre, si parla del concetto futuristico di “quantum money”, ossia valute digitali impossibili da falsificare grazie ai principi quantistici[59]. Anche se oggi questi aspetti di sicurezza sono più una precauzione per il futuro, essi mostrano come il quantum computing, oltre a promettere benefici computazionali, stia già costringendo il settore finanziario a evolvere le proprie misure di sicurezza (si pensi anche alla necessità di adottare algoritmi di crittografia post-quantistica, su cui NIST negli USA e l’ENISA in Europa stanno standardizzando).

Infine, va sottolineato che l’impatto economico potenziale è enorme. Secondo analisi di McKinsey, l’adozione estesa del quantum computing in finanza potrebbe generare tra i 300 e i 700 miliardi di dollari di valore aggiunto entro il 2035[7], tra maggiori ricavi, minori perdite per rischio e maggiore efficienza operativa. Naturalmente, questa stima presume che si riesca a superare le difficoltà tecniche nei prossimi anni. Nel frattempo, però, vediamo un crescente fermento. Grandi banche hanno creato team di ricerca interni su quantum computing, molte partecipano a progetti pilota e c’è un aumento degli investimenti venture in startup quantistiche focalizzate sulla finanza. È una corsa per capire come sfruttare questa tecnologia al meglio e anche per formare le competenze necessarie (quantitative analyst con conoscenze di quantum, ecc.).

Investire nel tema senza farsi catturare dalla narrativa

Dato il clamore attorno al quantum computing, molti investitori – istituzionali e privati – si chiedono come investire in questo campo emergente. Negli ultimi anni abbiamo visto la nascita di numerose startup quantistiche e l’ingresso in borsa di alcune di esse tramite fusioni SPAC (Special Purpose Acquisition Company), con valutazioni iniziali molto elevate sulla scia delle aspettative. Tuttavia, investire nel quantum computing presenta sfide peculiari e richiede prudenza per evitare di farsi trascinare da una narrativa entusiasmante ma talvolta sconnessa dalla realtà tecnica attuale[60][61].

Un primo punto da considerare è l’orizzonte temporale. Il quantum computing, per quanto promettente, è ancora in fase pre-commerciale su larga scala. Gli esperti stimano che potrebbero volerci uno o due decenni prima di dispositivi quantistici pienamente operativi in applicazioni mainstream[39]. Ciò significa che molte delle startup quantistiche di oggi non genereranno utili significativi nel breve periodo. Alcune società quotate hanno visto un fortissimo ridimensionamento del proprio valore proprio perché i mercati, dopo un iniziale entusiasmo, hanno iniziato a chiedersi quando (e se) arriveranno ricavi tangibili. Ad esempio, le azioni di aziende come Rigetti Computing e D-Wave – entrambe entrate in borsa tramite SPAC – sono crollate di oltre l’80-90% rispetto ai valori iniziali, a causa di risultati tecnici più lenti del previsto e di un generale spostamento degli investitori verso settori con ritorni più immediati[62]. Anche IonQ, una delle realtà più promettenti nel settore (qubit a ioni intrappolati), ha visto il suo titolo oscillare notevolmente: dopo un picco iniziale, è sceso di oltre il 60% dal debutto entro fine 2022[61]. Questo non perché IonQ o altre aziende abbiano fallito scientificamente – anzi, continuano a fare progressi – ma perché il mercato finanziario tende ad avere aspettative a breve termine poco compatibili con i tempi lunghi della ricerca. Investire nel quantum computing oggi significa dunque investire in R&S, con tutti i rischi che ciò comporta. È un investimento paziente, da valutare su scale temporali di 5-10 anni almeno, laddove molti investitori pubblici ragionano su trimestri.

Un altro aspetto è la valutazione delle società quantistiche. Spesso queste aziende, per attirare capitali, dipingono scenari molto ottimistici sul potenziale dei loro approcci – dopotutto devono competere per fondi e talenti. Non c’è nulla di male nell’avere visione, ma l’investitore deve saper distinguere la concretezza dalle mere dichiarazioni di marketing. Alcuni casi hanno sollevato dubbi; per esempio, l’azienda britannica ArQit, attiva nella crittografia quantistica, ha raccolto ingenti capitali ma ex dipendenti e analisti hanno poi suggerito che le sue promesse erano esagerate rispetto ai risultati ottenuti[63]. Questo insegna che prima di investire è importante valutare indicatori oggettivi: pubblicazioni scientifiche (l’azienda contribuisce in modo visibile al progresso tecnico? ha peer-review di qualità?), partnership con attori industriali o governativi (segno che la tecnologia è presa sul serio), roadmap credibili (che ammettano sfide e tempi, non solo proclami). In pratica, serve un’analisi deep tech. Non ci si può fermare alle slide patinate di presentazione, bisogna capire almeno a grandi linee qual è l’approccio quantistico dell’azienda e quali sono i suoi risultati sperimentali finora.

Bisogna poi tener conto che i grandi player tecnologici (IBM, Google, Microsoft, Amazon) stanno investendo pesantemente nel quantum computing, ma per loro rappresenta una piccola frazione del business complessivo. Un investitore retail che voglia esposizione al quantum potrebbe ottenerla indirettamente investendo in queste aziende consolidate, sapendo però che il successo quantistico futuro muoverà il loro valore azionario solo marginalmente (dato il peso di altri segmenti). In compenso, questi colossi hanno le spalle larghe per sostenere la ricerca quantistica a lungo termine senza rischiare il fallimento. Anche molte aziende di consulenza e semiconduttori tradizionali (come NVIDIA, Intel, Bosch, ecc.) stanno esplorando il quantum, talvolta investendo in startup, talvolta sviluppando prototipi interni. Seguire queste mosse può dare segnali su dove il settore si muove.

Una trappola narrativa da evitare è pensare che “quantum = successo garantito”. Nel recente assato altre tecnologie hanno attraversato cicli di hype simili – ad esempio l’intelligenza artificiale negli anni ’60 e ’80 ebbe i suoi “inverni” dopo eccessive aspettative non realizzate (vedi articolo 24). Il quantum computing è estremamente affascinante, ma la storia insegna che non tutti i progetti innovativi raggiungono il traguardo sperato. C’è il rischio che alcune startup adottino la filosofia “fake it till you make it” (fingi finché non realizzi) per ottenere finanziamenti, gonfiando le promesse. Alcuni fisici, come Nikita Gourianov di Oxford, hanno criticato pubblicamente certe esagerazioni e paragonato la situazione a una bolla dove “molti professionisti lavorano improduttivamente verso chimere”, avvertendo che prima o poi la realtà economica presenta il conto[10][39]. D’altro canto, figure come John Preskill invitano a essere ottimisti sul potenziale a lungo termine ma realistici nel breve termine, distinguendo ciò che i NISQ possono fare ora da ciò che i computer corretti faranno domani[40].

Prima di tutto, quindi, è importante informarsi a fondo; leggere report di ricerca (ce ne sono di ottimi delle società di consulenza e delle banche d’affari), seguire le conferenze del settore, magari consultare esperti indipendenti. Poi, valutare la trasparenza scientifica; se una startup pubblica regolarmente su riviste di alto livello o su arXiv i propri risultati, è un buon segno di solidità. Valutare il team; la presenza di scienziati di fama o di collaborazioni con enti governativi prestigiosi (es. progetti finanziati da DARPA, o dall’UE) indica credibilità. Diversificare; come già detto e destinare al quantum soltanto una quota di portafoglio che si è disposti ad allocare su investimenti ad alto rischio/high reward. In sintesi, riconoscere che nel breve termine la narrativa potrà subire alti e bassi. Fasi di entusiasmo (a ogni annuncio di “nuovo record di qubit” il mercato potrebbe esaltarsi) e fasi di disillusione (se i progressi tardano o emergono difficoltà impreviste). Un investitore paziente può sfruttare questa volatilità a proprio vantaggio se crede nel valore di lungo periodo. Un paragone utile è con la rivoluzione dell’aviazione all’inizio del ‘900. Tutti intuivano che gli aerei avrebbero cambiato il mondo, infatti è stato così; ma molte delle prime aziende aeree e costruttrici di velivoli fallirono lungo la strada e solo alcune emersero come vincitrici durature. Nel quantum computing potrebbe accadere qualcosa di simile. È un campo destinato quasi certamente a diventare importantissimo, ma quali aziende e tecnologie ne usciranno vincenti è tutt’altro che scontato oggi. Un investitore accorto deve bilanciare entusiasmo e scetticismo; non farsi catturare dalla narrativa dei comunicati stampa luccicanti, ma nemmeno ignorare un settore che potrebbe dare vita a una nuova industria multi-miliardaria nei prossimi decenni. In pratica, serve un approccio da venture capitalist: studiare l’innovazione, accettare i rischi elevati e avere pazienza.

Stay tuned!

Grazie per aver letto questo articolo. Se hai domande o desideri condividere le tue esperienze, lascia un commento qui sotto. La tua opinione è importante!

Fonti:

- Chen, E. et al. (2024). An elementary review on principles of qubits and their prospects for quantum computing. Nano Convergence, 11(1), 11. DOI: 10.1186/s40580-024-00418-5 [1][24] (Introduzione al quantum computing e progressi recenti, con attenzione a superamento dei limiti dei computer classici in campi come chimica, materiali, finanza.)

- National Institute of Standards and Technology – NIST (2023). Quantum Computing Explained. [2][13] (Articolo divulgativo NIST che illustra potenziali applicazioni rivoluzionarie del calcolo quantistico e spiega in termini semplici concetti come la sovrapposizione con analogie intuitive.)

- Moruzzi, M. (2020). Computer quantistico: perché serve una nuova alleanza Atlantica. Agenda Digitale[5][4] (Analisi sul posizionamento geopolitico e strategico del quantum computing, con dati sugli investimenti UE – 1 miliardo di euro – e l’esperimento di Google Sycamore: 200 secondi vs 10.000 anni.)

- Comitato per le tecnologie quantistiche (2023). Written evidence to House of Commons S&T Committee – Inquiry on Quantum Technologies[8][31] (Documento di esperti accademici al Parlamento UK che ridimensiona l’hype sul quantum computing, citando il fisico S. Das Sarma sul fatto che entanglement e superposizione non sono “bacchette magiche” e riportando le difficoltà attuali: dispositivi molto rumorosi, nessun problema pratico risolvibile ancora in modo utile.)

- Schneider, J. & Smalley, I. (2021). What is a qubit? IBM Research – Think Blog[11][12] (Spiegazione introduttiva del qubit come unità fondamentale di informazione quantistica e confronto qubit vs bit, dal blog IBM.)

- IBM Research (2021). IBM Quantum – Qubits versus bits[14][20] (Sezione del sito IBM Quantum che illustra con chiarezza la natura controintuitiva della sovrapposizione e definisce l’entanglement con esempi – “spooky action at a distance” – oltre a descrivere diverse tipologie di qubit: superconduttori, ioni, fotoni, quantum dot.)

- Mavroeidis, S. et al. (2022). Quantum Volume and the quest for a quantum advantage. Quantum Poet Magazine[28][66] (Articolo divulgativo avanzato che discute come il conteggio dei qubit fisici non basti – concetto di Quantum Volume introdotto da IBM – e cita esempi di hype mediatico, come l’annuncio prudente di IBM sul System One travisato dalla stampa come “primo computer quantistico commerciale”.)

- Das Sarma, S. (2022). Quantum computing has a hype problem. MIT Technology Review (March 28, 2022)[67][10] (Editoriale di un autorevole fisico (Das Sarma, U. Maryland) che mette in guardia contro il sensazionalismo: sottolinea i progressi reali ma anche che la commercializzazione è lontana, evidenziando il rischio di delusione se la comunicazione non è onesta sui tempi e le difficoltà.)

- Montanaro, A. (2016). Quantum algorithms: an overview. npj Quantum Information, 2(15023)[41] (Rassegna accademica che elenca le principali categorie di algoritmi quantistici conosciuti: crittografia (Shor), ricerca (Grover), simulazione di sistemi quantistici, risoluzione di sistemi lineari, apprendimento, ecc., fornendo un contesto su dove il quantum computing può dare vantaggi.)

- Arute, F. et al. (2019). Quantum supremacy using a programmable superconducting processor. Nature, 574(7779), 505-510[68] (Articolo scientifico storico del team Google AI Quantum che descrive l’esperimento di “supremazia quantistica” con 53 qubit: il processore Sycamore ha eseguito in 3 minuti un task di campionamento che al miglior supercomputer sarebbe richiesto in migliaia di anni.)

- Preskill, J. (2018). Quantum Computing in the NISQ era and beyond. Quantum, 2(79)[40] (Articolo seminale in cui Preskill introduce il concetto di era NISQ. Spiega che dispositivi con ~50 qubit potrebbero mostrare vantaggi su problemi specifici di fisica, ma sottolinea che il 100-qubit quantistico “non cambierà il mondo subito” e che bisogna puntare a migliorare la qualità dei qubit per arrivare al fault-tolerance.)

- Fitri, A. (2022). Investors love quantum computing. Experts fear a bubble. TechMonitor (Sep 13, 2022)[60][10] (Analisi giornalistica sul rischio bolla nel settore quantistico: riporta dichiarazioni di Das Sarma e di Nikita Gourianov. Gourianov afferma che molte start-up quantistiche non hanno un percorso chiaro verso la redditività e che con il mutare delle condizioni finanziarie (tassi in rialzo) il settore potrebbe subire una “correzione severa”; cita anche la frase di Gourianov sul fatto che gli attuali quantum computer sono “così error-prone che qualsiasi informazione processata degenera immediatamente in rumore”.)

- Hoover, A. (2023). Quantum Startups’ Stock Market Dreams Are Decohering. WIRED (Jan 18, 2023)[61] (Articolo su Wired che documenta le vicissitudini delle aziende quantistiche quotate via SPAC: Rigetti, D-Wave, IonQ. Indica che Rigetti ha perso ~90% dal debutto, D-Wave ~85%, IonQ -60%. Analizza come la modalità SPAC abbia permesso valutazioni elevate senza il vaglio tradizionale dell’IPO, e come l’aumento dei tassi e la fine della “bolla tech” abbiano impattato queste aziende, che rimangono non profittevoli e con tecnologia ancora lontana da applicazioni redditizie.)

- IBM News Room (2022). IBM’s roadmap for scaling quantum technology[27] (Comunicato IBM che annuncia gli obiettivi di sviluppo hardware: dopo aver realizzato processori a 127 e 433 qubit, l’azienda prevede di introdurre il chip “Condor” da 1121 qubit nel 2023. Questo fa parte di una roadmap fino al 2025 e oltre, che include l’integrazione di più processori modulari e il raggiungimento di capacità di errore corretto.)

- IonQ (2024). Our Novel, Efficient Approach to Quantum Error Correction (CliNR)[36][37] (Post sul blog di IonQ dove si presenta un nuovo metodo di error correction “parziale” chiamato CliNR: riduce l’errore logico di un fattore 2 con un sovraccarico di soli 3 qubit fisici per 1 logico, molto inferiore ai codici standard. Viene discusso come via intermedia tra semplice mitigazione degli errori e completa correzione, evidenziando la difficoltà dei metodi QEC tradizionali – migliaia di qubit per logico – e proponendo soluzioni pragmatiche nel frattempo.)

- Egger, D.J. et al. (2023). Quantum computing for finance: state-of-the-art and future prospects. Nature Reviews Physics, 5(8), 450–465[49] (Rassegna completa di IBM Research sullo stato del quantum computing applicato alla finanza. Identifica tre macro-aree: modellizzazione stocastica (es. simulazioni Monte Carlo avanzate), ottimizzazione (per trading, portafogli, allocazione di capitale) e machine learning quantistico per analisi finanziarie. Discute vantaggi attesi e limiti attuali, fornendo un punto di riferimento accademico sulle applicazioni finanziarie.)

- McKinsey & Co. (2025). The quantum leap in banking: redefining financial performance. McKinsey Insights (Henning Soller et al., Nov 2025)[50][56] (Rapporto delle principali applicazioni quantistiche in banca già esplorate: include casi studio come Citi con QAOA per ottimizzazione di portafoglio (migliore mix di asset con risposta più dinamica alle variazioni di mercato), Bank of Canada con quantum Monte Carlo per stress test (valutazioni di rischio più complete e veloci), Multiverse+Crédit Agricole per ottimizzazione del collaterale (riduzione tempi di calcolo e costi), Intesa Sanpaolo con IBM per frodi (QML che migliora accuratezza nel rilevare transazioni sospette). Evidenzia anche progetti di cybersecurity quantistica (OpenQKD con Danske Bank) e stima un impatto economico di $400-600 miliardi nella finanza al 2035.)

- Danske Bank (2022). Danske Bank helps researchers reach milestone within IT-security[57][58] (Notizia ufficiale Danske Bank del Feb 2022: prima trasmissione di dati quantisticamente criptati fuori dal laboratorio nei paesi nordici. Spiega che DTU e KPMG hanno realizzato con successo un collegamento QKD tra due computer della banca simulanti data center, ottenendo il primo trasferimento di dati “quantum-safe” su rete standard. Sottolinea come la tecnologia CV-QKD usata sfrutti la casualità quantistica per creare chiavi inviolabili e come banche e infrastrutture critiche debbano muoversi per adottare soluzioni di questo tipo anticipando l’avvento dei computer quantistici che romperanno la crittografia attuale.)

- Whiting, K. (2025). Quantum leaps: 3 ways banks can harness next-gen technologies for financial services. World Economic Forum Agenda (July 2025)[56] (Articolo divulgativo WEF che riassume tre ambiti in cui le banche stanno sperimentando tecnologie quantistiche: forecasting dei rischi (quantum computing per migliorare modelli di rischio e simulazioni economiche), sicurezza informatica (crittografia post-quantistica e QKD per proteggere dati finanziari), e customer experience (QML per rilevare frodi e predire churn). Conferma con esempi concreti, molti in linea con quelli citati da McKinsey.)

- Aaronson, S. (2022). Comment on “The Quantum Computing Bubble”. Shtetl-Optimized Blog (Aug 26, 2022)[10][39] (Il celebre informatico quantistico Scott Aaronson commenta l’editoriale di Gourianov su FT. Pur concordando su alcuni eccessi di hype, Aaronson difende i progressi veri del settore e nota che spesso chi critica ignora le prove del quantum advantage già ottenute in ambito accademico. Sottolinea che “nessuna tecnologia nasce utile”, ci vogliono anni di ricerca apparentemente “inutile” prima delle applicazioni: invita quindi a un cauto ottimismo, riconoscendo però che le timeline di alcune startup appaiono troppo rosee rispetto alle difficoltà scientifiche.)

- Harrow, A.W. & Montanaro, A. (2017). Quantum computational supremacy. Nature, 549(7671), 203-209[69] (Articolo di review sul concetto di quantum supremacy, spiegato nel contesto storico e con analisi dei primi protocolli di campionamento quantistico random. Utile per capire come definire e misurare un vantaggio quantistico computazionale e quali sono i caveat – ad esempio un vantaggio “fine a se stesso” su un problema artificiale non necessariamente si traduce in utilità pratica, ma rappresenta comunque un punto di svolta per la scienza computazionale.)

- Troyer, M. (2023). The Quest for Useful Quantum Advantage. Communications of the ACM, 66(7), 58-66. DOI: 10.1145/3590959 (Panoramica aggiornata da un ricercatore di Microsoft sulle sfide per raggiungere un vantaggio quantistico utile. Discute la dimensione dei problemi che i NISQ possono trattare vs quelli utili industrialmente, il ruolo dei nuovi algoritmi NISQ-friendly, e fa il punto sullo stato della correzione d’errore. Conclude che un vantaggio pratico potrebbe emergere inizialmente in aree come la simulazione quantistica di materiali o in alcuni algoritmi ibridi, ma richiederà comunque miglioramenti incrementali negli hardware.)

- Fowler, A.G. et al. (2018). Surface codes: Towards practical large-scale quantum computation. Physical Review A, 86(3), 032324. DOI: 10.1103/PhysRevA.86.032324 (Lavoro fondamentale sul codice a superficie per quantum error correction. Spiega il funzionamento del codice, la soglia di errore ~1%, e fornisce stime di risorse: migliaia di qubit fisici per ciascun qubit logico a seconda dell’errore di base e del circuito da eseguire. È la base teorica dietro le affermazioni odierne di quanti qubit serviranno per applicazioni come Shor su RSA2048 e simili, contestualizzando il gap tra i dispositivi attuali e quelli necessari.)

- Skilton, M. & Hovsepian, F. (2021). The 4th Industrial Revolution: Responding to the Impact of Artificial Intelligence on Business. Palgrave Macmillan – Chapter on Quantum Computing[65] (Capitolo che include il quantum computing nell’evoluzione delle tecnologie disruptive. Pur focalizzato sull’AI, dedica un approfondimento a come il quantum la potenzierà (Quantum AI) e cita preoccupazioni su hype e tempi. Utile a comprendere la collocazione del quantum nell’ambito della “Quarta rivoluzione industriale”, cioè come tassello assieme ad AI, IoT, 5G, ecc, e come le imprese devono prepararsi investendo ora in competenze quantistiche.)

- Federal Reserve Bank of Boston (2023). Quantum Computing for Finance: Overview and Policy Implications. Boston Fed Working Paper[53][7] (Rapporto di ricerca che discute l’impatto del quantum computing sul settore finanziario dal punto di vista di un regolatore. Oltre a rivedere applicazioni come pricing di derivati e ottimizzazione di portafoglio, analizza implicazioni per la stabilità finanziaria e per la regolamentazione: ad esempio, la potenziale necessità di aggiornare gli standard di sicurezza informatica, o di monitorare un futuro in cui chi possiede un computer quantistico può avere vantaggi informativi sui mercati. Stima scenari di adozione e invita le banche centrali e le autorità a iniziare fin d’ora programmi di ricerca quantistici per non farsi trovare impreparate.)

Invia la tua richiesta

Se ti serve supporto per impostare strategie solide, scrivimi. Partiamo da obiettivi, vincoli e rischio; poi applichiamo metodo quantitativo e una cornice comportamentale per ridurre errori ricorrenti e rendere le decisioni più disciplinate.

Nota: le informazioni condivise sono di natura generale; eventuali valutazioni operative richiedono le verifiche e la documentazione previste.

Grazie per la risposta. ✨